Seit relativ kurzer Zeit taucht bei jedem heise.de-Artikel ein kleiner Knopf neben der Überschrift auf, der die Aufschrift „Vorlesen“ trägt. Klickt man darauf, wird der Text der Meldung als Audiodatei abgespielt, die offenbar mit einer Text-to-Speech-Funktion generiert wurde. Sprechende Machinen kennt man ja zur genüge vom Telefonbanking, aber dieser Schritt zeigt, dass die Maschine im Vorlesen mittlerweile offenbar „gut genug“ geworden ist, so dass bei heise alle Texte fortan gesprochen zur Verfügung stehen. (Der Vollständigkeit halber möchte ich ergänzen, dass dort steht „Testbetrieb der Sprachausgabe bis zum 9.11.07“) Nchfolgend eine Audiokostprobe des Artikels „Heinz Nixdorf Museumsforum zeigt Hollerithmaschine“…

Seit relativ kurzer Zeit taucht bei jedem heise.de-Artikel ein kleiner Knopf neben der Überschrift auf, der die Aufschrift „Vorlesen“ trägt. Klickt man darauf, wird der Text der Meldung als Audiodatei abgespielt, die offenbar mit einer Text-to-Speech-Funktion generiert wurde. Sprechende Machinen kennt man ja zur genüge vom Telefonbanking, aber dieser Schritt zeigt, dass die Maschine im Vorlesen mittlerweile offenbar „gut genug“ geworden ist, so dass bei heise alle Texte fortan gesprochen zur Verfügung stehen. (Der Vollständigkeit halber möchte ich ergänzen, dass dort steht „Testbetrieb der Sprachausgabe bis zum 9.11.07“) Nchfolgend eine Audiokostprobe des Artikels „Heinz Nixdorf Museumsforum zeigt Hollerithmaschine“…

[audio:/wp-upload/hnf.mp3]

Update 6.6.2007

Die Financial Times Deutschland zieht nach: Auch die FTD bietet jetzt ihre Artikel (z.B. diesen hier „Bush-Nachfolger drohen Iran mit Atomschlag“) mit Vorlesefunktion (jetzt selber hören) an.

Die Financial Times Deutschland zieht nach: Auch die FTD bietet jetzt ihre Artikel (z.B. diesen hier „Bush-Nachfolger drohen Iran mit Atomschlag“) mit Vorlesefunktion (jetzt selber hören) an.

Update 29.1.2008

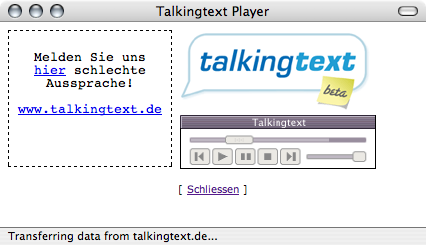

Mittlerweile – das war klar, oder – gibt es einen Web 2.0-Dienst, den man natürlich komfortabel in das eigene Blog einbinden kann. Talkingtext füllt diese große Lücke, die da klaffte.

Zuerst gesehen habe ich das im

Fernstudiumblog, bei dem man sich bereits alle Beiträge vorlesen oder wahlweise als Audiofile einfach runterladen kann. Das sieht dann so aus wie in der Abbildung (Fenster) gezeigt.

Allerdings hat tt noch ein paar beta-bedingte Probleme (Stand 30.1.2008):

- Der Registrierungsprozess für ein Blog ist viel zu kompliziert, statt einfach die Standard Feed-URL zu nutzen braucht das Blog einen eigene Feed-URL, die ein Plugin für WordPress erzeugt

- Das WP-Plugin ist an sich ne tolle Sache, funktionierte bei mir aber nur lokal

- Das Playerfenster ist doch ziemlich arg hässlich, da wünscht man sich ein custom skinning für Farbe, Buttons, Headlines usw.

- Was ohne Ende nervt ist, dass man sich auf der Managementseite stets neu einloggen muss (keine Cookies) – das sollte schleunigst behoben werden

- Die Registrierung eines neuen Blogs ist absolut kryptisch, man bekommt zig Mails und blickt es irgendwann gar nicht mehr. Warum kann ich den einzubindenden Code nicht im Managementportal einfach einsehen?

- Das die Umwandlung Zeit kostet ist klar, aber zumindest eine kleine Audio“vorschau“ bzw. ein pre-Hearing der Stimmen sollte doch möglich sein, oder??

- Sowie man sich einlogged sollte gezeigt werden wie weit der Fortschritt für die Text-to-Audo-Konvertierung fortgeschritten ist, dass man nicht so raten muss.

- Das Menü der Managementseite ist wirklich arg beta, nichtmal die Eingabefelder für die wichtigen Sachen sind kommentiert.

- Die leicht esoterische Musik im Hintergrund ist ja vielleicht ganz nett, aber zumindest eine optinale Abschaltung sollte drin sein, besser noch eigenes mp3-loop hochladen können

Weitere Infos sollten sich im Blog von talking text finden lassen.

Why do i blog this? Mir kommt die Stimme bekannt vor! Genau die Stimme habe ich auf meinem Laptop schon einmal gehört und ich war ziemlich begeistert von der Qualität der individuellen „Vorlesung“, denn der Computer spricht alles immer exakt gleich aus, egal wie oft er es vorliest, das kann kein Mensch so gut! Die Stimme heißt glaube ich „Klaus Infovox iVox HQ“ auf dem Mac. Durch Eingabe des Unix-Befehls say -v "Ralph" -o ralphLiestVor.aiff "This is the Weblog Thetavellehh." kann man beliebigen Text mit beliebigen Stimmen automatisch in eine Audiodatei umwandeln.

Ich finde dieser Schritt von Heise macht deutlich, dass Text-to-Speech das Tor zur sprechenden Maschine weiter aufgestossen hat.

Sience Fiction aus Star Trek wird peu à peu Wirklichkeit und bald sprechen die Maschinen noch viel mehr. Damit einher geht, dass der Computer unsichtbarer werden kann, weil er kein optisches Display mehr braucht, um seine Informationen zu übermitteln. Ein Audio-Display tritt an seine Stelle. In Star Trek ist dadurch die Brücke (siehe Grafik rechts als Beispiel) ein sehr aufgeräumter Ort ohne Tastaturen, Maus oder gar Desktop-Rechnergehäusen, nur noch die wirklich grafisch notwendigen Informationen werden auf den optischen Displays gezeigt, die Kommunikation mit dem Rechner findet per Audio statt. Heise lässt den Rechner sprechen, jetzt fehlt nur, dass ich Heise auch ganz einfach etwas sagen kann, z.B. „Computer, lies bitte schneller vor!“ ;-)

Sience Fiction aus Star Trek wird peu à peu Wirklichkeit und bald sprechen die Maschinen noch viel mehr. Damit einher geht, dass der Computer unsichtbarer werden kann, weil er kein optisches Display mehr braucht, um seine Informationen zu übermitteln. Ein Audio-Display tritt an seine Stelle. In Star Trek ist dadurch die Brücke (siehe Grafik rechts als Beispiel) ein sehr aufgeräumter Ort ohne Tastaturen, Maus oder gar Desktop-Rechnergehäusen, nur noch die wirklich grafisch notwendigen Informationen werden auf den optischen Displays gezeigt, die Kommunikation mit dem Rechner findet per Audio statt. Heise lässt den Rechner sprechen, jetzt fehlt nur, dass ich Heise auch ganz einfach etwas sagen kann, z.B. „Computer, lies bitte schneller vor!“ ;-)

Eine kleine Sensation hat sich diese Woche ereignet. Auf der

Eine kleine Sensation hat sich diese Woche ereignet. Auf der  Offenbar haben einige gemerkt, dass das Aufbohren des Webbrowsers mit JavaScript-Bibliotheken nicht die „ultima ratio“ für sichere und zuverlässige, optisch ansprechende Userinterfaces sein kann. Es läuft nun scheinbar Stück für Stück auf Client-Applications hinaus, die harmonisch mit dem OS zusammenspielen und die grafischen Fähigkeiten des OS für ein gutes Userinterface nutzen. Sun nennt das

Offenbar haben einige gemerkt, dass das Aufbohren des Webbrowsers mit JavaScript-Bibliotheken nicht die „ultima ratio“ für sichere und zuverlässige, optisch ansprechende Userinterfaces sein kann. Es läuft nun scheinbar Stück für Stück auf Client-Applications hinaus, die harmonisch mit dem OS zusammenspielen und die grafischen Fähigkeiten des OS für ein gutes Userinterface nutzen. Sun nennt das  Seit relativ kurzer Zeit taucht bei jedem

Seit relativ kurzer Zeit taucht bei jedem  Die

Die

Sience Fiction aus

Sience Fiction aus